Susan Anderson è un filosofo. Suo marito Michael, invece, è un informatico che dedica il suo tempo allo studio della robotica e dell'intelligenza artificiale. Cosa hanno in comune i due, oltre a condividere gioie e dolori della vita di coppia? Hanno collaborato alla realizzazione di un robot in grado di comportarsi secondo un'etica.

"Ci sono macchine che sono già pronte a fare cose che hanno a che fare con l'etica, come le macchine per il prelievo automatizzato di contanti, e molte altre sono in fase di sviluppo, come macchine che possono guidare da sole e robot per accudire gli anziani" spiega Susan, professoressa di filosofia al college of Liberal Art and Sciences. "Vi piacerebbe essere certi che si comportino in modo etico?".

Il campo dell'etica applicata alle macchine combina intelligenza artificiale con le teorie dell'etica per determinare se una macchina si comporta secondo un codice morale oggettivamente condivisibile. Il problema non sta nel far applicare determinate regole ad una macchina, ma stabilire quali debbano essere queste regole.

Una di queste potrebbe essere l'approccio definito "prima facie", introdotto dal filosofo scozzese David Ross negli anni '30 del secolo scorso, in cui una persona (o una macchina, in questo caso) si trova nella situazione di dover bilanciare diversi obblighi morali al momento di dover prendere una decisione, come decidere di essere corretto, di fare del bene, di non danneggiare nessuno, di mantenere promesse o di mostrare gratitudine.

Il problema di questo approccio, tuttavia, è sempre stato quello di definire delle regole universalmente valide per dare un peso a questi obblighi morali e prendere giuste decisioni. "Non c'è un principio decisionale all'interno di questa teoria, per cui non era mai stata largamente utilizzata" afferma Susan.

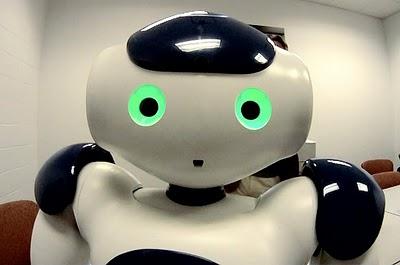

La Anderson e suo marito hanno sfruttato le vaste potenzialità di Nao, un robot bipede che viene spesso utilizzato per fare ricerca nel campo dell'intelligenza artificiale, programmandolo attraverso un principio etico che consente al robot di determinare quanto spesso ricordare ad una persona di prendere delle medicine, e se notificare ad un supervisore (come un medico) quando il paziente si rifiuta di assumere i farmaci.

Ricordare a qualcuno di prendere le proprie medicine può sembrare un compito banale, ma in realtà nasconde diversi tranelli sotto il punto di vista etico: il robot deve evitare che il paziente si faccia del male non prendendo le medicine, ottenendo però un corretto bilanciamento con le libertà individuali di una persona. Un robot troppo assillante può ottenere l'effetto opposto; e un robot che non ricorda con la frequenza necessaria quando prendere un farmaco può causare danni al paziente.

"Dovremmo iniziare a pensare alle cose che i robot possono fare per noi se solo avessero dei principi etici" dice Michael. "Le macchine potrebbero imparare importanti caratteristiche etiche, doveri morali, e principi decisionali che potrebbero governare il loro comportamento".

La ricerca dell' "etica robotica" è ancora in fase embrionale, ma i coniugi Anderson ripongono molte speranze in questo settore. Lavorare in questo ambito non solo ci donerebbe robot più complessi e simili a noi, ma potrebbe aiutare anche a comprendere più a fondo l'etica umana, fino addirittura ad ispirare l'umanità dando un esempio da seguire.

Certo appare quasi paradossale che il creatore possa prendere ispirazione dai principi morali che lui stesso ha donato alla sua creatura. Ma mai dare nulla per scontato o per impossibile, non si fa altro che porre le basi per essere smentiti in futuro.

The ethical robot (w/ Video)